1、前言

随着云计算为核心的第四次信息技术革命的迅猛发展,信息资源已成为与能源和材料并列的人类三大要素之一。作为信息资源集散的数据中心正在发展成为一个具有战略意义的新兴产业,成为新一代信息产业的重要组成部分和未来 3-5 年全球角逐的焦点。数据中心不仅是抢占云计算时代话语权的保证,同时也是保障信息安全可控和可管的关键所在,数据中心发展政策和布局已上升到国家战略层面。

数据中心是一整套复杂的设施。它不仅仅包括计算机系统和其它与之配套的设备(例如通信和存储系统),还包含配电系统、制冷系统、消防系统、监控系统等多种基础设施系统。其中,制冷系统在数据中心是耗电大户,约占整个数据中心能耗的30~45%。降低制冷系统的能耗是提高数据中心能源利用效率的最直接和最有效措施。制冷系统也随着数据中心的需求变化和能效要求而不断发展。下文简要回顾和分析了数据中心发展各个时期的制冷技术应用,并展望了未来数据中心的发展方向。

2、风冷直膨式系统及主要送风方式

1994年4月,NCFC(中关村教育与科研示范网络)率先与美国NSFNET直接互联,实现了中国与Internet全功能网络连接,标志着我国最早的国际互联网络的诞生。1998~2004年间中国互联网产业全面起步和推广,此时的数据中心正处于雏形阶段,更多的被称为计算机房或计算机中心,多数部署在如电信和银行这样需要信息交互的企业。当时的计算机房业务量不大,机架位不多,规模也较小,IT设备形式多种多样,单机柜功耗一般是1~2kw。受当时技术所限,IT设备对运行环境的温度、湿度和洁净度要求都非常高,温度精度达到±1℃,相对湿度精度达到±5%,洁净度达到十万级。依据当时的经济和技术水平,计算机房多采用了风冷直膨式精密空调维持IT设备的工作环境,保证IT设备正常运行。

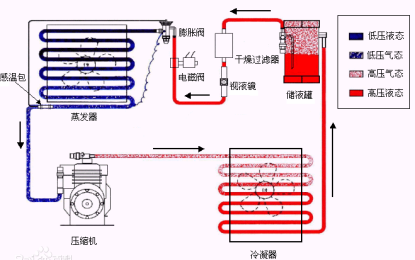

风冷直膨式精密空调主要包括压缩机、蒸发器、膨胀阀和冷凝器以及送风风机、加湿器和控制系统等,制冷剂一般为氟里昂,单机制冷量10-120KW。原理如图1所示。每套空调相对独立控制和运行,属于分散式系统,易于形成冗余,可靠性较高,具有安装和维护简单等优点,是这个时期数据中心大量采用的空调方案。缺点是设备能效比较低,COP(Coefficient Of Performance)值小于3.0,室内外机受到管道距离限制。

图1 风冷直膨式精密空调原理图

风冷直膨式精密空调室内机一般部署在机房一侧或两侧,机房内的气流组织方式一般采用两种:送风管道上送风方案和架空地板下送风方案。风管上送风方式是指在机房上空敷设送风管道,冷空气通过风管下方开设的送风百叶送出,经IT设备升温后负压返回空调机。该方法的优点在于安装快速,建造成本低。缺点是受到各种线缆排布和建筑层高限制,送风管道截面无法做大,导致风速过高,送风量无法灵活调节。这种送风方式在低热密度的机房应用较多。

图2 风管上送风案例

地板下送风是另一种,即使是现在,也是大量数据中心项目中仍在使用和新建采用的一种气流组织方式。这种方式利用架空地板下部空间作为送风静压箱,减少了送风系统动压,增加静压并稳定气流。空调机将冷空气送至地板下,通过送风地板通孔送出,由IT设备前端进风口吸入。该方法的优点在于机房内各点送风量可以通过送风地板通孔率调整,同时,通过合理布置数据中心机房线缆和管道,可以少量敷设在地板下,保证美观。缺点是随着使用需求的增长和调整,地板下敷设的电缆不断增加,导致送风不畅,甚至形成火灾隐患。

图3 地板下送风案例

3、水冷系统

2005~2009年间互联网行业高速发展,数据业务需求猛增,原本规模小、功率密度低的数据中心必须要承担更多的IT设备。此时的单机柜功率密度增加至3~5kw,数据中心的规模也逐渐变大,开始出现几百到上千个机柜的中型数据中心。随着规模越来越大,数据中心能耗急剧增加,节能问题开始受到重视。

传统的风冷直膨式系统能效比COP(Coefficient Of Performance)较低,在北京地区COP约为2.5~3.0,空调设备耗电惊人,在数据中心整体耗电中占比很高。而且,随着装机需求的扩大,原来建设好的数据中心建筑中预留的风冷冷凝器安装位置严重不足,噪音扰民问题凸显,都制约了数据中心的扩容。此时,在办公建筑中大量采用的冷冻水系统开始逐渐应用到数据中心制冷系统中,由于冷水机组的COP可以达到3.0~6.0,大型离心冷水机组甚至更高,采用冷冻水系统可以大幅降低数据中心运行能耗。

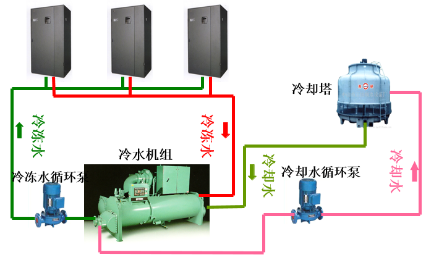

冷冻水系统主要由冷水机组、冷却塔、冷冻水泵、冷却水泵以及通冷冻水型专用空调末端组成。系统采用集中式冷源,冷水机组制冷效率高,冷却塔放置位置灵活,可有效控制噪音并利于建筑立面美观,达到一定规模后,相对于直接蒸发式系统更有建造成本和维护成本方面的经济优势。

图4 水冷系统

冷冻水系统应用最多的空调末端是通冷冻水型精密空调,其单台制冷量可以达到150kw以上。送风方式与之前的风冷直膨式系统变化不大,仅仅是末端内的冷却媒质发生变化,空调设备仍然距离IT热源较远,主要依靠空调风扇输送空气维持气流组织。

4、水侧自然冷却和新型空调末端

2010~至今,随着数据中心制冷技术的发展和人们对数据中心能耗的进一步关注和追求,自然冷却的理念逐渐被应用到数据中心中。

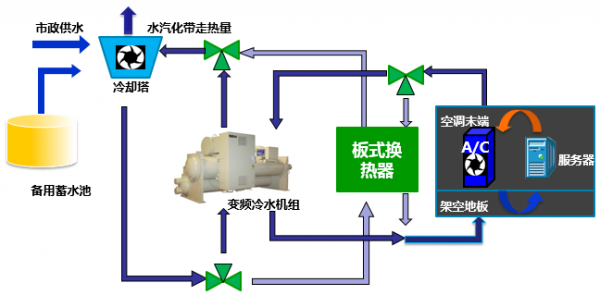

在我国北方地区,冬季室外温度较低,利用水侧自然冷却系统,冬季无需开启机械制冷机组,通过冷却塔与板式换热器“免费”制取冷源,减少数据中心运行能耗。水侧自然冷却系统是在原有冷冻水系统之上,增加了一组板式换热器及相关切换阀组,高温天气时仍采用冷水机组机械制冷,在低温季节将冷却塔制备的低温冷却水与高温冷冻水进行热交换,在过渡季节则将较低温的冷却水与较高温的冷冻水进行预冷却后再进入冷水机组,也可以达到降低冷水机组负荷及运行时间的目的。

图5 水冷系统自然冷却系统原理

传统数据中心的冷冻水温度一般为7/12℃,以北京地区为例,全年39%的时间可以利用自然冷却,如果将冷冻水提高到10/15℃,全年自然冷却时间将延长至46%。同时由于蒸发温度的提高,冷水机组COP可以提升10%。另一方面,随着服务器耐受温度的提升,冷冻水温度可以进一步提高,全年自然冷却的时间也将进一步延长。目前国内技术领先的数据中心已经将冷冻水温度提高至15/21℃,全年自然冷却时间可以达到70%甚至更长。

水侧自然冷却系统虽然相对复杂,但应用在大型数据中心项目中的节能效果显著。水侧自然冷却系统日渐成熟,已经成为我国当前数据中心项目设计中最受认可的空调系统方案。我国目前PUE能效管理最佳的数据中心也正是基于水侧自然冷却系统,全年PUE已实现 1.32。

在冷源侧系统不断演进发展的同时,新型空调末端形式也层出不穷。

传统的机房精密空调机组结构形式相对固定,设备厚度一般为600mm,宽度为2500mm左右,风量约27000m3/h,其机组内部风速达到7米/秒,空气阻力很大,风机大量的压力损失在了机组内部,造成了很大的能量浪费。一般配置了450Pa风机全压的空调机,机外余压只有大约200Pa。

图6所示的AHU风机矩阵是一种新型的空调末端,运行时由AHU设备的回风口吸入机房热回风,顺序经过机组内部的过滤器、表冷器等功能段。降温后的空气由设置在AHU前部的风机矩阵水平送入机房,冷空气送入机房冷区,即机柜正面,冷却IT后升温排至热区,即机柜背面封闭的热通道内,向上至回风吊顶,又回到空调回风口,如此周而复始循环。这种新型的空调末端改变了机房布置和传统精密空调机组的内部结构,大大增加了通风面积,截面风速可以控制在3米/秒以下,减少了空气在设备内部多次改变方向并大幅减小部件布置紧凑导致的阻力。末端能耗最多降低约30%。

图6 AHU风扇矩阵设备

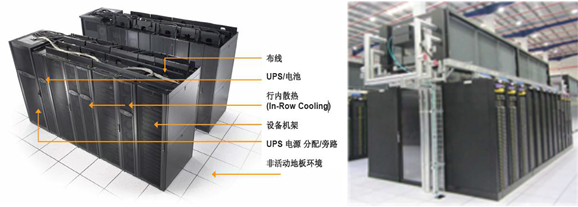

行级空调系统(Inrow)和顶置冷却单元(OCU)是一种将空调末端部署位置从远离负荷中心的机房两侧移至靠近IT机柜列间或机柜顶部的空调末端侧的优化,形成了我们称之为靠近负荷中心的集中式制冷方式。行级空调系统由风机、表冷盘管,水路调节装置、温湿度传感器等组成,设备布置在IT机柜列间。行级空调通过内部风机将封闭通道的热空气输送至表冷盘管,实现冷却降温, IT设备根据自身需求将低温的冷通道空气引入,通过服务器风扇排至封闭的热通道,实现水平方向的空气循环。行级空调系统(Inrow)因靠近负荷中心,因输送冷空气至负荷中心的距离减小,设备维持制冷循环所需的能耗会比传统方式降低。顶置冷却单元与行级空调系统制冷循环很相似,但顶置冷却单元仅由表冷盘管、水路调节装置、温湿度传感器等组成,设备本身不再配置风机,表冷盘管设置于机柜顶部。IT机柜风扇将排出的热空气聚集到封闭的热通道内,通过热压的作用,热空气自然上升,经过机柜顶部的顶置冷却单元表冷盘管降温后,因热压作用开始下降,并再由IT机柜风扇吸进IT设备降温,实现垂直方向的空气循环。顶置冷却单元(OCU)因其本身就没有配置风扇,热压作用维持了空气的自然流动循环,使得空调末端设备的能耗消耗降低至极致至0。以华北地区某个应用了行级空调系统(Inrow)和顶置冷却单元(OCU)冷却技术的大型数据中心为例,年均PUE可实现1.3以下。

图7 行级空调系统(Inrow)和顶置冷却单元(OCU)

从传统精密空调到行级空调系统(Inrow),再到顶置冷却单元(OCU),不难发现,空调末端正越来越向热源靠近,目的就是减少冷却媒质输送的能耗,以输送低温冷冻水替代输送冷空气,提高冷却效率。目前服务器级的浸泡冷却方案已经开始小规模测试,这种方案利用了冷却介质的相变就可以实现服务器的冷却,由于减少了介质转换温差,冷源侧可以减少机械制冷或者不使用机械制冷,这将大大降低制冷系统能耗。