中国IDC圈7月12日报道:在这种情况下,一旦电源发生故障,虽然服务器依靠ups系统能够继续运行。但由于制冷设备停止运行,致使机房温度快速上升,仍会导致服务器过热而停止运行。数据中心的功率密度与日剧增,高密度数据中心也开始被更多的人所关注。尤其是在这样的盛夏,数据中心高密度问题更是需要处理的难点。

如果给整个机房盲目降温,会造成机房整体温度不均甚至造成机房过度制冷,不仅浪费了电力资源还增加了额外的支出。所以说机房降温固然重要,但是解决高密度问题也是一大重点。今天我们就从解决数据中心高密度的几个关键技术入手,看看有哪些适合的解决方案。>>

解决数据中心高密度设计问题

当前不计成本的高性能计算时代已经一去不复返了,解决尖端问题的高端系统同样也必须降低成本。为了避免由于服务器爆炸性增加而造成机房面积过快扩大以及随之而剧增的各种运行维护费用,机构数据中心要求大幅度缩小服务器(以及存储设备和网络通信设备)的占地面积、提高计算密度、发展高密度计算。

这一方面要求采用新的服务器设计和器件实现更高的计算密度,另一方面要求建设能够支持高密度计算机系统安全稳定运行的数据中心,即高密度计算数据中心。

建设高密度数据中心注意点

高密度数据中心虽然与大多数数据中心一样也必须致力于提高能效,但它们在供电和散热两方面都对机房基础设施的容量规划和电源和制冷设施建设提出了更高的要求。从设计角度来分析,建设高密度数据中心必须从如下三方面着手:

1.合理配置机架和空调设备,通过定量计算每个机架的功率密度和热负荷,优化服务器设备在机架中的布局以及机房内机架和空调的布局,为高效供电和散热创造条件;

2.优化供电设施,给每个机架供给足够和适度的电力,满足高密度计算的需要;

3.优化散热制冷系统:把高密度计算元器件在每个机架内部产生的高热量带出机架,避免由于局部高热点而影响设备的稳定运行,甚至损毁部件、造成灾难性的后果;>>

数据中心制度保障是关键

合理规划机房布局,机柜采用冷热通道分离,冷通道完全封闭等措施,优化气流组织,从而大幅提高空调制冷效率;提高设备运行率:配电、制冷系统均有大效率运行点,提高设备运行率发挥设备大效率,有效减少能源的损耗;创新节能思路:合理采用新技术、新方案。妥善密封数据中心环境、优化气流组织、适当使用节能装置、提高制冷系统效率、靠近散热源制冷五点,这样能将低30%至45%的制冷系统能源成本,节省大量经常性开支。结合诸多新兴技术,如高效处理器和基于芯片的新制冷技术,即使服务器密度和能源价格持续上升,上述措施依然能够将能源成本保持在较低水平。

如何更好有效措施保证机房安全,应对极端高温、高湿、雷暴等天气给机房带来的不良影响呢?

建立机房应急机制

首先是建立监控预警机制技术部门分析历年气象数据并结合气象部门发布的近期天气预报信息,及时发出预防性调整通报;例如:在极端天气出现时如何调整设备设定状态、备用发电系统测试检查、后备燃料调配、防雷设施及接地系统检查等。l设施监控人员密切关注环境监控数据(机房内外温湿度、空调系统、配电系统、消防系统运行状态),如发现监控数据有异常,监控人员将按照相应程序进行汇报、提取数据、分析原因等,将可能发生的问题消灭在萌芽阶段。

其次是人员应急调度机制建立应急事件领导小组,在极端天气发生时,做到“预警”、“分析”、“处理”三步,领导小组分析天气状况可能会对机房运行造成风险,对相关运行部门提出运行建议;极端天气状况发生后,分析监控数据、借助人员巡检信息,及时调整或变更运行方案;相关专业技术人员随时待命,留守设备现场,以备设备故障后的排险、修善工作。

最后是建立应急机制制定IDC安全运行应急机制,例如《火灾应预案》、《电力系统故障应急预案》、《制冷系统故障应急预案》等;以电力故障-市电中断为例:预案中制定了详细的发电机启动切换流程、后备燃料供给措施、人员调配措施、故障通报流程等。

高密度机房供电系统

高密度计算数据中心中的机架经常是满载的、功率很大,过去一个机架功耗为2-3kW,现在却往往高达20-40kW.早期的机架配电方式已经无法满足高密度设备机架不断增长的电力需求。因此,必须采用创新的机架配电技术来满足为高密度机架供应充足的电力并确保持续稳定运行的要求,包括:

1.支持通过冗余电源实现设备的冗余操作:冗余电源系统需要两个配电电路,分别用于两个电源总线。如果一个总线出现故障,另一路总线仍可处理整个系统的负载。

2.支持高电压和三相电源:传统数据中心利用单相电流工作,其功耗已经不能满足现代高密度计算的需要。因此要求改用三相电源,使用称为高电压交流电源的208伏、三相系统。三相电源通常比单相电源更加高效。此外,与单相电源相比,三相电源更为稳定,更多时间都可处于峰值电压,降低供电损失和发热,不仅能够为满载刀片服务器的机架提供足够功率,而且能够更加稳定持续供电,确保系统的安全稳定运行,从而为支持高密度数据中心供电提供一种通用且经济的电源。

3.使用分段配电技术,能够降低由于过载或维护所引发的意外宕机机率,并减小管理员连续打开多个服务器组而产生的浪涌电流,提高供电的安全性。

4.采用节电配电机柜:通过将数据中心的集中配电改为区域配电方式,将配电管理移到“区域”级,解决了从机箱到机架的集成电源管理问题,并提高供电效率。

5.提供电路监控功能:通过部署可持续监控电流负载的组件,数据中心可以使用少量人力实现高效运行管理。各系统可轻松实现配电电路负载均衡,防止因过载或设备损坏而引发的意外宕机。为了简化管理,用户可以选用模块化PDU管理模块,利用它们来监控数据中心的电源环境。当前市场上已有很多新型配电装置(PDU)可供选择,其中惠普公司新型的模块化PDU在每个机架上集成了插座、电缆与断路器,提供一系列领先的特性支持高密度机架稳定安全稳定运行和节电。>>

高密度机房制冷转变

优秀的数据中心制冷方案具有4个基本原则,特别是高密度负载数据中心:向设备通风口送入温度适宜的足量空气;最小化冷/热空气混合;控制到空调的回流气体路径;大化到空调的回流气体温度。如果正确实施,遏制可以帮助实现这4个原则。

究竟什么是遏制呢?

冷/热通道设计旨在减少冷/热空气混合的发生,遏制将这个目标提高到了一个新的水平,冷/热通道朝前迈出了一大步,使得给高密度负载降温成为可能,但随着热输出量的增加,一些之前频现的空气混合问题又开始慢慢出现了,其主要原因很容易识别和解决。

如果存在开放的空间,则热空气不能留在热通道内,冷空气不能留在冷通道内,因此,机柜中的所有开口必须堵住,防止热空气在计算机和非连续机架之间的空间重新循环,同时也防止宝贵的冷空气从这些开口流失,在未使用的机架空间使用空白挡板的原则最容易被大家忽略,它会导致大量无效的数据中心制冷,浪费能源。

但还有两个因素需要考虑:热量增加后,风扇将会带走它们能带走的热空气,随着热量密度的增加,热空气会溢出机架的顶部,再次返回到服务器,随之设备需要更多的冷空气,最显着的解决方案的是在这些地方设置障碍,在通道的末尾设置墙体和门,将机柜顶部通道塞进天花板,这就是所谓的遏制。

热空气现在完全被捕获到热通道,因此它不会泄露,冷空气被控制在冷通道中,因此也不会被浪费掉,看起来很简单,但真的是这样吗?我们进一步分析下。

热通道遏制

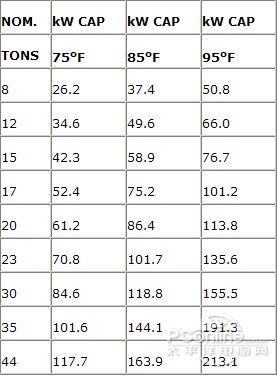

热通道遏制通常比冷通道遏制更容易让人接受,在能源效率方面有一个小小的优势,其支持者提醒其它空间和冷通道拥有一样舒适的环境,不需要做任何制冷,根据ASHRAE修订的数据处理环境热量指导原则,温度应该在75°F(23.9°C)左右,另一个版本预计很快就将发布,它可能会为某些设备分类再次扩大温度和湿度范围。

大部分空间的温度都保持在合理范围内,因此设备风扇可以从任何地方吸入空气,虽然我们应该尽力给硬件提供充足的空气,但也不用像冷通道遏制那样控制得那么严格。

热通道遏制主要的缺点是工作环境,温度可能会达到95°F或更高,这可不是什么舒服的工作环境,但与流行的看法相反,它不会超出OSHA标准,为了降温,一些设计在控制区域引入了适量的冷空气,使温度保持在可接受的范围,但很明显,这会抵消掉遏制解决方案获得的效益。

冷通道遏制

数据中心制冷遏制方案是否灵丹妙药?

不同回流空气温度时典型的CRAH额定容量

冷通道遏制一个大的好处是可以使用地板下或数据中心顶部制冷模式,通道易于填充冷空气,防止热空气混入,确保所有可用的冷空气都可以输送给设备,大限度地减小机架顶部和底部之间的温度差异,使用地板下空气输送时,冷通道遏制特别有用,因为冷空气下沉,使地板下空气供应完全违反了物理学定律。

当冷空气通过地板瓷砖开口向上推时,它只会上升到某个高度,除非有什么力量再推它一把。计算机内的风扇通常会把热空气向上推,但它仍然会变得越来越热,如果我们可以从地板到天花板完全遏制冷通道,它交付的空气温度将趋于稳定。

正如前面提到的,冷通道不需要低到55°F,新的ASHRAE将上限提高到了80.6°F(27°C),因此冷通道温度在75°F时是非常安全的,这个温度允许你加大机房空调单元的凝结点,这样可以节省大量的空调能源。但反对者指出,其它空间现在基本上都成了一个热通道,可能会达到95°F或更高,除了冷通道外,其它一切都变得不舒适。

冷通道遏制真正的挑战是空气平衡和控制,计算机设备需要一定数量的空气进行制冷,当空气输送给冷通道时,你需要确保可以充分调整开孔或地板开口,或天花板上方的铁格子。>>

高密度机房机架配置

机架是数据中心机房内安装各种设备(服务器、存储和网络设备等)的重要组件,也是整个散热基础设施的重要组成部分。例如,各种服务器、存储与网络设备的机箱就是插入在机架中,通过各种线缆联接成为高密度计算系统。因此,解决好机架的供电和内部的散热等问题是提高高密度计算系统散热效率的关键。

为此,首先要合理配置机架内部设备。随着服务器功耗的提高,传统的数据中心往往不得不把机架大多数容量空置、来避免供电不足和过度发热,这显然不利于高密度数据中心的建设。反之,如果机架过满又很可能会超出机房供电和散热的能力。

因此,必须从定量计算机架功率密度和热负荷出发、合理配置机架内部设备,从而充分利用机房供电和散热的能力,奠定建设高密度数据中心的基础。至于,如何计算在一个标准机架中可以容纳多少台这样的服务器和估算一个机架内服务器的功耗会更加困难。

因为计算功耗需要参考多个变量(如每个机架内的服务器数量、每台服务器组件的类型和数量等)。对于机架而言,一个非常有用的标准是功率密度,即每机架单位的功耗(瓦/单位)。功率密度包含了机架密度所涉及的所有变量。实际上,计算机所消耗的电源几乎全部都转变成了热量。计算机所产生的热量一般以英国热量单位BTU/小时来表示,1瓦等于3.413BTU/小时。

因此,可以按照下式来计算出机架热负荷:热负荷=功率[瓦]x3.413BTU/小时/瓦。例如,一台惠普公司制造的DL360G4服务器的热负荷为:460瓦x3.413BTU/小时/瓦=1,570BTU/小时。一个42U机架容纳DL360G4服务器的热负荷将近65,939BTU/小时。数据中心的配置主要环绕功耗和热负荷与机房供电和散热能力的配合。

IT设备厂商一般会在其产品规格中提供功率和热负荷信息,在设计高密度数据中心时,必须根据厂商提供的数据估算每机架的功率和热负荷,进行数据中心机房规划。

规划中,需配置足够的电源、并留有足够的余量,既要避免因配置容量不足而影响设备正常运行,又要避免因留有余量过大而导致能效降低。在设计和建设高密度计算数据中心时必须评估各种设备的电源需求与热负荷,进行合理的机架配置。

比较好的方法是静态智能散热技术,通过使用流体动力学模型进行模拟、根据已明确的数据中心设备的热负荷,来确定冷却资源的最佳布局和供应量。它可以将每一个空调设备的散热负荷与其额定功率进行比较,以判断空调设备是否得到了高效的利用或过分“供应”。>>

高密度的数据中心布线

高密度的数据中心中,传统的主干和水平链路配置(如常见的每个EDA机柜接入24根双绞线或24芯光纤)已经不能适应刀片式服务器及SAN存储设备的需求,而由端口数量增加引起的机柜安装单元的占用又与昂贵的数据中心单位面积成本形成极大的矛盾。

面对挑战,大量新的布线技术应运而生,如采用屏蔽铜缆系统提高线缆和连接硬件的安装密度,采用刀片式跳线杜绝高密度环境跳接插拔误操作的可能性,采用光纤预端接系统简化线缆布放和端口连接,采用角型配线架减少水平理线架的数量,采用机柜间垂直空间安装跳接端口等。

但是6A系统因需考虑外来串扰的影响,线缆外径和端口间距均较以前的布线类别有所增加,无法顺应高密度数据中心的发展趋势。而Z-MAX6A铜缆系统采用创新的推拉式RJ45设计,使跳线可以更快的移动、增加和变更,特别适合48端口的机架式交换机和插卡式交换模块。配合另一个专利的LockITTM技术,还可以给每个BladePatch刀片式快接跳线的插头端增加一个安全锁,防止了未经授权的端口访问,提高了数据中心的安全性和可靠性。

光纤应用是数据中心的另一个热点,基于FC的存储区域网络需要大量的光纤连接,而新型的SAN导向器又把接口密度提升到1U96芯,下一代的40G/s和100G/s网络更是直接需要8芯/20芯光纤的支持。传统的光缆熔接技术不再适应高密度大批量的光纤安装,新的MTP/MPO预端接技术以其优异的性能和快速的实施方式获得了数据中心用户的青睐,成为高密度数据中心光纤连接的技术。

据权威部门对数据中心能耗所作的统计,在现在运行的数据中心中,电源和制冷占了数据中心绝大部分的辅助用电能耗,尤其是制冷,占了38%左右。IT需求不断扩大与能源效率间的矛盾日益紧张,传统的数据中心能源消耗过大的问题更是日益凸显,而解决高密度数据中心的难题也成为了数据中心建设发展的必然。相信随着云计算、大数据、移动互联网的日益发展,高密度数据中心的难题也会随着技术的发展迎刃而解。