伴随国家对金融安全的关注度不断提高,数据中心基础设施作为业务安全的关键节点,其高可用能力成为实现银行业务连续性目标的核心关键因素。本文以数据中心基础设施的网络系统为例,结合网络架构和网络运维能力的现状,从技术架构、运营能力两个方面开展案例分析,总结提出系统分层级的高可用提升方法,并围绕高可用技术、运营能力转型实践展开了分析说明。

近年来,随着国家对金融安全的关注度不断提高,以及银行业数字化转型的持续深入,金融科技领域的业务连续性水平成为衡量银行服务品牌竞争力与行业声誉的一项重要指标。与此同时,数据中心基础设施的高可用能力作为确保生产业务安全稳定的重要支柱,不仅是商业银行达成监管要求的必备条件之一,而且对保障社会稳定、控制金融风险也有着极为重要的现实意义。

一、商业银行数据中心可用性分析

在信息科技领域,可用性主要指基于各类计算机设备的连接组合,使构建的企业信息系统可以稳定支撑业务连续运作,并在系统级的生命周期内不发生影响业务办理的故障。对于商业银行而言,数据中心基础设施本身是一套极为复杂的技术体系,综合部署包括设备、网络、服务器等在内的各类资源,其可用性能力主要由各类基础设施的系统可用性决定,并同时受到设备产品、架构设计、运营能力等多种因素的影响。在量化评估方面,系统可用率的指标评价通常遵从业界常用的衡量方法,即从99%到99.999%俗称“几个9”的量化指标体系,数据中心可用性示例见表1。

表1 数据中心可用性示例

当前,随着商业银行数字化转型的不断深入,各种新技术、新架构持续迭代更新,并对转型过程中的系统高可用能力带来了极大挑战。对此,商业银行在进行高可用设计时不仅要对产品、技术、架构等进行可用性评估,加强对新技术、新架构的风险控制,还需要引入高效的自动化工具提供自主可控的运营服务,特别是强化出现生产故障时的应急处置能力,减少和消除意外出现的生产故障中断时间。尤其在运营能力方面,首先要打造一支思想统一、技能齐备的技术团队,既能够遵从安全第一的工作要求,具备严谨、审慎的合规意识,同时还需掌握专业技术、具备创新意识,能够通过DevOps、SRE的方法打造适合自身使用的特色化工具。此外,运营能力建设离不开配套的自动化工具支持,以更好地满足数据中心云化后的大规模运维需求以及数据中心高可用要求。

二、数据中心基础设施高可用提升方法及案例说明

本文以数据中心基础设施中的网络系统为例,结合网络架构和网络运维能力的现状,从技术架构、运营能力两方面开展案例分析,总结提出系统分层级的高可用提升方法,并围绕高可用技术、运营能力转型实践等展开了分析说明。

1.基础设施可用性提升

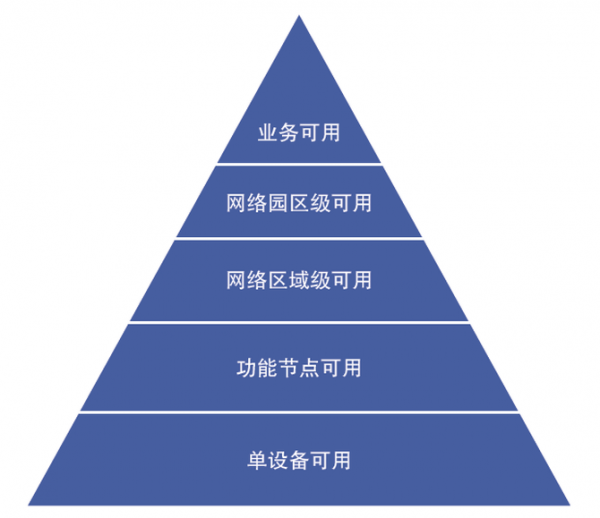

网络系统作为数据中心基础设施的核心组件之一,其系统可用性内容大致可划分为设备级可用指标、功能级可用指标、区域级可用指标、园区级可用指标等四个层级,并依次自下而上构成了数据中心的高可用能力之一(如图1所示)。其中,网络架构高可用设计以增加网元、线路、节点、区域等结构冗余度为核心思路,旨在使每一层均能够充分应用技术路线的可扩展能力,进而基于各层级的高可用能力建设,最终顺利到达并具备业务可用层能力。在这一阶段,业务连续性指标可达到99.999%的可用率,并作为核心能力之一,支持向用户提供高价值的数字化产品和服务。

数据中心系统可用性分级

设备级可用重点强调单台网络设备的产品级可用率及支持网络单元(NU)的可用性。单设备可用性即网元层级可用性指标,起步按99.99%可用指标要求部署网元,落实产品技术和部件冗余的技术要求。同时,该层级可用能力还需关注设备的运行时长因素,设备可用性指标在超过5年以上时会逐年下降,需及时更新置换对应节点的设备。举例来说,核心环节交换机、路由器设备基于自身双电源、多端口、双引擎等硬件技术冗余,应支持设备连续运行保持在年度99.999%及以上的可用率。

功能级可用重点强调一个网络区域内多台同等功能的网络单元对外服务的可用率。功能节点可用性即核心节点层级的可用性指标,按照网络技术发展的支持情况,扩展核心功能节点的网元设备群组可支持的冗余数量,如目前已有功能节点在技术上支持部署2台以上设备,包括交换核心、互联网接入、数据中心互联等环境。举例来说,基于技术产品的发展成熟度,生产网络中的区域核心交换机按照双机双活搭建,交换核心、路由器等设备可按照2~4台的数量搭建,互联网接入渠道功能节点按照单园区6台搭建,而上述措施均为通过架构设计的冗余,旨在赋予设备在故障情况下的网络功能节点高可用能力。

区域级可用重点强调多台网络设备通过特定方式互接提供网络连通服务的区域可用率。网络区域可用性即单个网络区的可用性指标,网络区主要由不同网络单元的功能节点互相连接而成,泛指提供服务器接入、访问控制、路由转发、负载均衡、存储连接等多种网络服务的网络系统。从冗余设计的角度来看,“鸡蛋不要放在一个篮子里”,因此需要对网络区的部署规模进行控制,如数据中心可按照多个网络区冗余进行架构设计,以及将应用分布到多个区域运行,以避免因单个网络区异常产生全局影响。举例来说,在数据中心规模持续增长的情况下,提供计算资源接入服务的网络区域建设按照冗余架构的设计考虑,可搭建2个以上的逻辑隔离区域,以支撑应用单元化部署和计算资源的分布式部署,同时应将云资源域规模限制在1000台左右,并搭建2个以上的基础服务功能相同的资源域。

园区级可用重点强调数据中心不同网络区组合支持大规模计算资源正常运转服务的可用率。园区可用性即数据中心单个园区网络的可用性指标,在该层级中,网络的可用性能力取决于网络架构设计的耦合程度,以及区域间出现异常后的隔离能力。在园区级的网络中,如果下一个层级出现的异常事件与多个网络区存在耦合,则往往不能及时隔离影响,进而导致产生园区级的网络可用性问题。举例来说,网络架构可在多个园区间复制搭建,用以支撑数据中心多个园区的同等网络服务支撑能力,并按松耦合结构进行设计,保持多个园区间的互联互通,以实现园区级网络在异常情况下的高可用切换。

2.运营能力提升路径

运营能力提升涉及ITIL流程中的变更、应急等各个方面,其中针对变更实施、应急实施的自动化工具是保持可用率的核心关键,而不同生产运维能力上限对应的可用率指标大致可分为人工级、自动级、智能级等三个层级。

人工级是指通过预设操作命令,手工实施部署。该层级可用率在资源充分投入的情况下,一般可以支持3个9到4个9的专业系统可用率。例如,在运维操作全生命周期的管理和技术流程中,大量生产维护工作均由人工处理,当出现影响业务的重大故障时,问题的定位效率较低,应急处置时间多数超过30分钟,且部分情况下或将长达1~2个小时。

自动级是指通过工具实现自动化操作、人工按键式处理或告警触发式处理。该层级可用率在资源充分投入的情况下,可以支持4个9以上的专业线系统可用率。例如,生产运营中的标准运维操作大多通过自动化工具完成,包括管理流程、技术操作、日常运维等内容,当出现影响业务故障时,即可通过一键式应急自动化工具进行隔离、切换等应急操作,从而将业务影响时间控制在30分钟之内。

智能级是指通过引入AI弱智能技术,预防式发现隐患,并在发生故障时工具自主开展全链条自愈恢复。该层级可用率在资源充分投入和技术发展成熟后,可以支持5个9以上的专业系统可用率。例如,在生产运营的运维工作中,在标准操作被自动化完成后,针对非标准运维操作,则可以基于智能化工具开展预防性监测,进而在故障隐患影响到业务前,执行有效预判并开展计划性维护,提前解决影响业务运行的问题。

三、未来展望

综上,数据中心可用率在以一年为周期统计的高可用模式下,其可用率指标应保持在99.99%以上,而最终目标是提升至99.999%的世界一流水平,全年网络宕机时间控制在5.4分钟以内。然而,上述指标对当前信息系统的可用性要求可谓非常之高,而在前述网络系统案例中,通过对可用性进行分层设计,并结合架构设计和运营团队建设,将可有效支持数据中心的高可用提升。未来,随着运维智能化等IT技术的持续演进,数据中心的高可用提升路径也将愈加丰富,通过“技术+运营”两方面创新,将不断驱动数据中心基础设施的高可用水平提升,进而更好地保障国家网络安全和社会金融稳定。