1. 公司机房发展史

随着互联网行会的飞速发展,公司对于IT信息方面的应用的越来越多。如今任何公司都离不开网络,小的几十至上百人员上网需求,一台路由器加数台交换机组成公司网络。大的成千上万的客户端全球分公司互联,防火墙、VPN、认证准入、高端路由交换,成百上千齐全的网络设备来保障公司正常网络需求。

一般公司成立之初、员工和业务较少、网络设备和服务器也就数台。机房就是一个小房间、几台设备、一个机柜搞定。

随着公司业务规模、人员扩展;小机房里的机柜也开始成倍的增加。这一阶段主要还是在以扩展网络接入为主题。

当公司规模逐渐扩展、业务需求也更加复杂和多样化。原本只规划用做网络接入的机房已经无法满足这些需求,众多的内部业务需要用服务器来支撑,无稳定的环境为公司提供持续的服务。为保障这些设备能够放在一个良好的环境当中运行,只能选择是托管或自建服务器机房。于是乎开始规划建设自己的数据中心机房。

2. 自建专业机房的必要性

2.1 需求导向

2.1.1 内部业务扩展

公司网络环境比较复杂,网络规划非常重要。随着公司规模的不断扩展。网络设备、公司网站、邮件系统、OA系统、数据库系统、文件服务器、FTP服务器、内网研发平台服务器等的大量需求。分散式的小机房已无法满足需求。而自建机房则可以对办公数据、研发数据等进行更加合理网络规划与划分。

2.1.2 大量需求集中管理的高效性

随着公司规模的壮大,企业人员规模、内部业务系统也都随之扩展。内部用网设备规模日渐庞大,大量的需求分布在大厦的各个楼层,集中管理是大势所趋。网络设备、服务器及其它IT应用的设备都可以进行集中的管理,可灵活的规划自有资源的使用。应急情况处理方便且高效,如日常发生服务器突然宕机或其他故障可以在第一时间进行现场重启和维护。减少了很多的沟通成本提高维护效率。

2.2 保障研发数据安全

互联网行业普及的当下企业的信息安全受到越来越多的重视。在保护好研发数据安全及企业其他的无形资产信息资产的大前提下,我们必须做更多的思考和规划。那么如果能在一个集中化管理的环境中对所以终端网络权限进行统一的设定;同时将研发环境和线上运营环境完全独立开来,对研发数据进行重点的隔离保护,报障重要的数据不被外泄。这些需求使得自建服务器机房无疑成为了刚需。

2.3 虚拟化的规模优势

互联网行业尤其是软件研发企业,内部对研发环境服务器的需求是非常大的。这便面临需要在虚拟化和物理服务器器之间的选择。相信大家都能理解,虚拟化方案在集中管理、扩展性、故障转移等方面具备的优势非常明显。但虚拟化架构的基础投入并不低,要实现对物理服务器的成本优势还需要一个大的前提就是规模效应。而我们现在正好具备这一前提,那自然要让虚拟化大行其道。

3. 机房建设规划

机房作为公司核心网络设备,办公应用、内部软件研发等业务硬件支撑的心脏。机房的建设、区域划分、设备选型等前期需要做充足的规划,保证了后期的健康运行和扩容。

机房的建设分为多个系统,装饰系统、电力系统、制冷、综合布线、新风、防雷、消防等等“。在这里我们主要是介绍几个关键系统的前期规划和设备选型。

3.1 机房面积规划

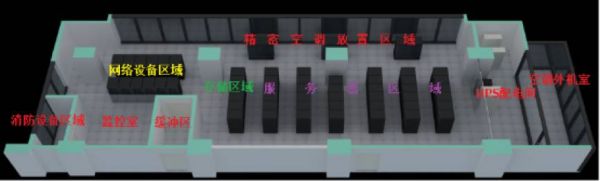

根据网络设备数量、服务器数量、服务器设备增长预留余量。机房配置600*950服务器机柜50个,2排可放置100台塔式服务器机架。用于搬运设备的通道不小于1.5米;机柜正面和背面正常距离为1米至1.2米。根据容量计算,主设备间需要140平方米。

辅助区的面积一般为主机房的0.5至1倍。监控室的面积按3.5至4平方米计算。结合写字楼的实际场地、辅助区规划100平方米。机房总面积规划为240平方米。

3.2 机房功能区域规划

精密空调区:用于摆放三台精密空调,为机房制冷;

网络设备区域:用于放置公司核心网络设备、呼叫设备、机房服务器的接入层网络设备和机房接入层配线架;

存储区域:放置存储设备区域;

服务器区域:服务器机柜集中区域;

UPS配电间:安放UPS电池柜和2台配电柜;

空调外机间:放置精密空调外机;

消防设备区域:放置消防气瓶和消防设备区域;

监控室:日常办公,机房管理和监控;

缓冲区:用于进出机房人员换衣、换鞋的区域,同时也是防跟随确认区,进入机房需要进过两道门禁刷,以保证安全。

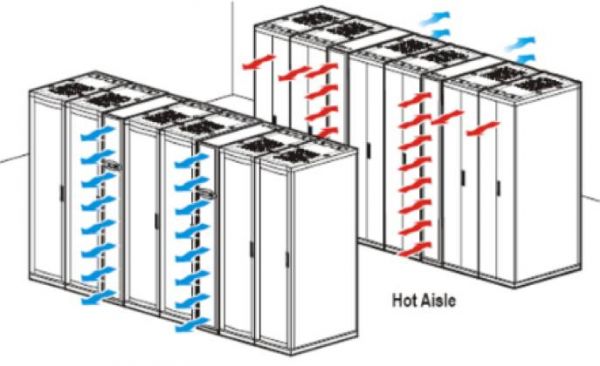

3.3 制冷系统

由于机房设备都会释放大量热量,为保持这些设备安全稳定地运行,就一定要使机房室内保持恒定的温度,空调系统的制冷循环部分就必须为机房源源不断地提供制冷量,同时也具有除湿的功能。

机柜热量循环:

3.3.1 制冷规划和选型

制冷系统承载通常计算采用“功率和面积法”计算机房总冷量比较准确;机房主要的热负荷来源于设备的发热量及维护结构的热负荷。根据以往经验,除主要的设备热负荷之外的其他负荷,如机房照明负荷、建筑维护结构负荷、补充的新风负荷、人员的散热负荷等可根据机房的面积进行估算,鉴于机房的实际情况,环境热负荷取180W/m2进行计算。

采用“功率及面积法”计算机房热负荷:

Qt=Q1+Q2

Qt:总制冷量(KW)

Q1:室内设备负荷(=设备功率×0.8)

Q2:环境热负荷(=0.1KW/m2×机房面积)

具体选型过程如下:

Qt=Q1+Q2

Qt:总制冷量(KW)

Q1:室内设备负荷(=设备功率×0.8)

Q2:环境热负荷(=0.1KW/m2×机房面积)

Q1=120KW*0.8=96KW

Q2=0.1KW/m2*180/m2=18KW

所以180平方机房推算所需要的总制冷量公式:

Qt=Q1+Q2=96KW+18KW=114KW

所以理论上180平方机房应配置总制冷量110KW左右的精密空调;以满足机房的相关需求

根据计算结果,机房采用3台30KW功率的精密空调,一般情况下开启2台,还有一台精密空调备用,一个月轮询一次。机房的温度和湿度分别维持在23℃±2℃、50%RH±5%。

3.3.2 设备选型

1、备份自动切换功能、当群组中机组故障时备用机组自动投入运行、提高空调系统的可靠性;

2、轮巡:定时切换到备份机组;

3、根据机房内热负荷的变化自动控制机组中空调机的运行数量;达到节能的目的;

4、具有标准的报警功能:高温报警、低温报警、高湿报警、低湿报警、系统高压报警、系统低压报警、滤网堵报警、风量丢失报警、其他用户自定义报警等;

5、国产知名品牌、价格相对实惠,售后有保障;

6、采用下送风,上回风方式送风,这种方式送风均匀,噪音小;

7、功率30KW左右。

机房精密空调2台使用、一台备用。在精密空调的设备选型上、出于成本考虑,选择国内口碑不错的品牌即可。

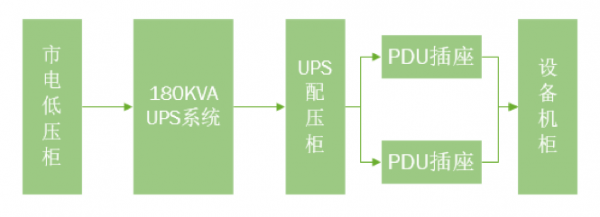

3.4 电力系统

市电功率

电力系统作为机房至关重要的系统,出现故障影响非常大。在配电规划上也要考虑到一定的余量。

机房主要电力负荷:

空调:30KW*3=90KW

照明:8KW

新风机:4KW

网络和服务器设备:180KW*0.8=144KW

机房总功率:90+8+4+144=246KW

UPS

UPS后备电源以提供应急保障,考虑到公司区域和该写字楼电力较稳定。根据机房业务和成本考虑。保障时间控制在1个小时左右。

UPS容量计算:

公式:设备总负载功率/在线式UPS功率因子(一般为0.8)=UPS容量(VA)

144KW/0.8=180000VA

考虑到UPS容量的冗余、一般以20%到30%,UPS的容量应该为180000VA *1.2=216000VA.

电池容量计算:

以1小时计算,216000VA*1H/(0.8*384V)=703AH

需要选用4组200AH的电池。每组为384V/12V=32节。

3.5 环境监控

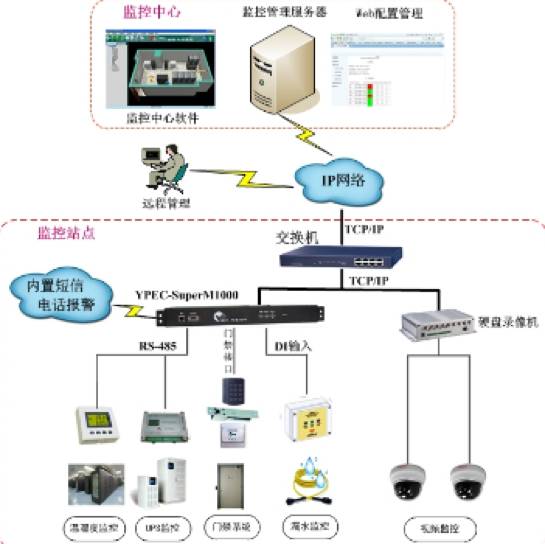

机房的环境设备(供配电、 UPS、空调、消防、保安等)必须时时刻刻为计算机系统提供正常的运行环境。一旦机房环境设备出现故障,就会影响到计算机系统的运行,对数据传输、存储及系统运行的可靠性构成威胁,如事故严重又不能及时处理,就可能损坏硬件设备,造成严重后果。现在大部分专业机房都采用了环境监控系统,环境监控系统对机房的精密空调、机房温湿度、门禁系统、电力系统、漏水、视频等故障通过邮箱、短信、电话、声音实时报警。通过环境监控系统的报警,能及时的通知机房管理人员处理突发的故障,保障机房设备正常运行。

3.5.1 环境监控系统规划

1、使用方便,界面友好,能够以组态图的形式直观的显示环境监控的状态,能够方便的进行操作控制;

2、数据和报警信息存储时间不少于6个月;

3、能对门禁、漏水、温湿度、市电、ups、新风机、视频监控、精密空调进行监控;

4、可以采用邮箱、短信、电话、声光报警;

5、可以自定义报警级别。

4. 总结

通过以上这些规划,我们已经可以组织好一份基本的IDC服务器机房建设的需求;那么剩下的事情就是通过招标找供应商来负责土建工程实施。这部分具体的细节暂时不做详细的说明了。架构数据中心应该注重节能和持续发展,因为随着业务的发展,需求自然是不断扩展。

互联网行会的飞速发展,公司对于IT信息方面的应用的越来越多。内部需求导向下越来越多的公司自建机房。机房也成为企业重要的一个组成部分,机房建设固然是一项不可轻视的工程。绝大多数的企业的机房建设都是外部给供应商、机房建设的好坏,取决于供应商设计的理念和技术水平。我们作为机房的使用者而非建设者。在众多机房相关的系统下,我们不需要每个都非常了解透彻。但是机房关键系统建设和机房前期规划我们需要掌握一些基本的信息。在自身也清楚机房建设的注意事项的情况下,可以对施工服务团队施加多一层监督,让机房建设可以得到更大程度的保障。

5. 我们一路踩过的坑

机房建设前的规划、建设中期的施工各方面都考虑的比较仔细。但是在使用过程中才发现在前期的规划施工中也有考虑的不到位。不经意的埋下了多个坑。

5.1 冷凝水问题

机房在冬天需要保温、夏季需要隔热以及防止冷凝水等问题,这里主要是强调冷凝水的问题、,下层天花冷凝水是比较常见的。尤其是南方这边的回南天。机房地板保温做不到位就比较容易出现。

机房建设在写字楼,楼层高度限制以及地板厚度不够,铺完保温棉后静电地板下面空间不是太高,冷空间在静电地板下堆积。在回南天时楼下天花板有冷凝水。后期通过增加精密空调风道解决冷凝水问题。也带来了“后遗症”,因施工不便风道并没有整个机房都做到位,机房部分区域温度相对其它位置偏高。

在建设机房时(尤其是南方)因充分考虑到冷凝水的问题,后期再去解决不仅费时费力。解决不好也会产生新的问题。在建设时因考虑到楼层厚度不够的问题、可以在整个机房做精密空调风道。

5.2 机房漏水

机房设备对水极为敏感。机房防水不容忽视,轻者造成机房设备受损,业务中断,降低使用寿命;重者造成设备损坏和数据丢失,带来严重甚至无法挽回的经济损失。

机房范围内有下水管道,空调冷凝水管道直接通过机房中的下水管排水,后期接口出现漏水,水回流到机房大片区域。

机房的建设者都清楚机房防水的重要性。在建设机房时也有充分的考虑漏水隐患。机房应彻底避免水源隐患,空调冷凝水必须使用管道引排至室外或者下一层地漏。

5.3 配电规划不仔细

公司办公地点分布在同一栋楼的多个楼层、每个楼层有一个接入层小机房。避免市电跳闸、停电等,小机房的电力通过强电井从自建中心机房UPS接入。为节约成本,在规划时各楼层小机房共用一路电。出现过物业强电井维护时短路,UPS上的空气开关跳闸、所有小机房设备停电的故障。为避免集体跳闸问题,重新从中心机房单独拉线到每个楼层小机房。

为避免断电事情发生,前期规划时就需要每个小机房单独从UPS上接入。

5.4 精密空调高压报警

放置精密空调外机外机的位置因空气循环不畅,导致高压告警。当时根据供应商的建议,在外机区域的窗户上用抽风机散热。在使用中发现散热效果不理想。抽风机24小时运行容易故障。使得精密空调经常高压报警,不制冷。持续了2个夏天,增加了过多的人力成本。后采用风道的解决方案。给每个精密空调外机增加一个风道。风道成本低廉,效果明显。彻底解决了精密空调高压报警问题。

仅以此献给有心筹划企业自建机房的小伙伴们。